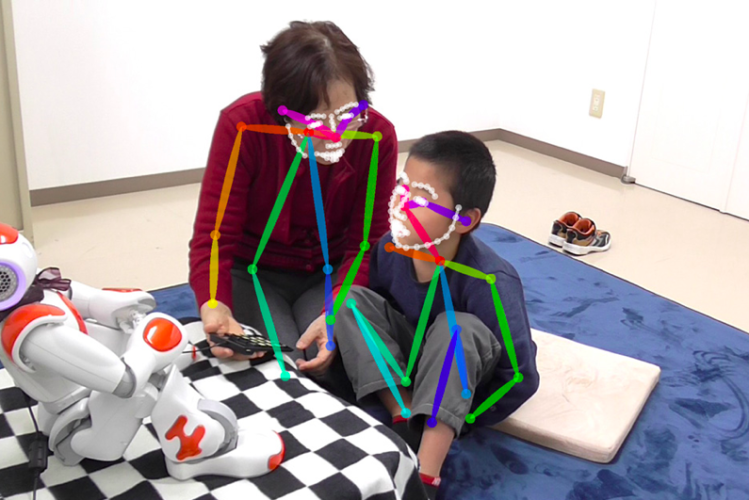

一个由人形机器人NAO (SoftBank Robotics)增强的治疗过程,该机器人被用于EngageMe研究。使用CMU知觉实验室的OpenPose工具对肢体/面部进行跟踪。(资料来源:麻省理工学院媒体实验室)

患有自闭症谱系障碍的儿童通常难以识别周围人的情绪状态——例如,区分高兴的脸和恐惧的脸。为了弥补这一点,一些治疗师使用儿童友好型机器人进行自闭症治疗,以展示这些情绪,并让儿童参与模仿这些情绪,并以适当的方式对它们做出反应。

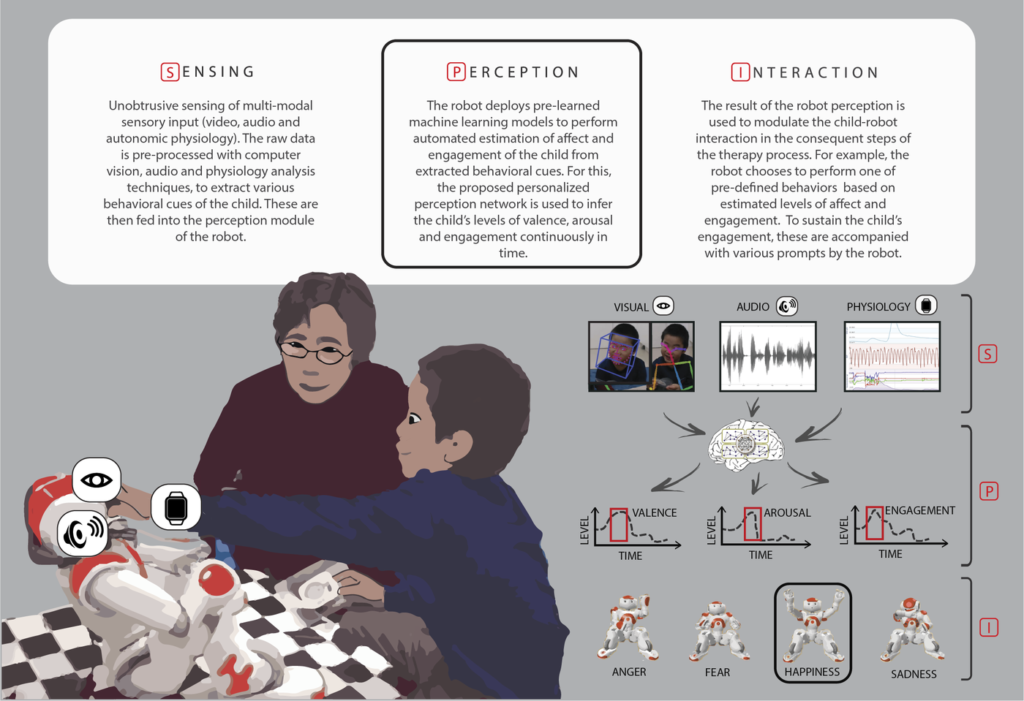

然而,这种类型的治疗效果最好,如果机器人能够顺利地解释孩子自己的行为——无论他或她在治疗期间是感兴趣、兴奋还是集中注意力。麻省理工学院媒体实验室(MIT Media Lab)的研究人员现在开发了一种个性化的机器学习,利用每个孩子独有的数据,帮助机器人评估每个孩子在这些互动过程中的参与度和兴趣。

有了这个个性化的“深度学习”网络,机器人对孩子们反应的感知与人类专家的评估一致,相关度为60%。

对于人类观察者来说,要对孩子的参与和行为达成高度一致是很有挑战性的。他们的相关分数通常在50%到55%之间。Rudovic和他的同事们认为,像这项研究一样,经过人类观察训练的机器人,有一天可以对这些行为提供更一致的估计。

Oggi Rudovic解释说:“我们的长期目标不是创造机器人来取代人类治疗师,而是在机器人身上添加关键信息,治疗师可以利用这些信息来个性化治疗内容,并在机器人和自闭症儿童之间进行更吸引人、更自然的互动。”她是媒体实验室的博士后,也是这项研究的第一作者。

这篇论文的合著者、麻省理工学院(MIT)教授罗莎琳德·皮卡德(Rosalind Picard)领导了情感计算的研究,她说,机器人的个性化对自闭症治疗尤其重要:一句著名的格言是:“如果你遇到一个自闭症患者,你就遇到了一个自闭症患者。”

“创造用于自闭症的机器学习和人工智能的挑战尤其令人烦恼,因为通常的人工智能方法需要大量的数据,这些数据对于学习的每个类别都是相似的。在异质性占主导地位的自闭症中,正常的人工智能方法失败了,”皮卡德说。Rudovic、Picard和他们的队友也在其他领域使用个性化深度学习,发现它可以改善疼痛监测和预测阿尔茨海默病进展的结果。

用于自闭症治疗的机器人:与NAO会面

机器人辅助治疗自闭症的工作原理通常是这样的:人类治疗师向儿童展示代表不同情绪的不同面孔的照片或卡片,教他们如何识别恐惧、悲伤或喜悦的表情。治疗师然后对机器人进行编程,让它向孩子展示同样的情感,并观察孩子与机器人互动的过程。孩子的行为提供了有价值的反馈,机器人和治疗师需要继续上课。

研究人员使用了SoftBank RoboticsNAO本研究中的人形机器人。NAO几乎有2英尺高,看起来像一个穿着盔甲的超级英雄或机器人,它通过改变眼睛的颜色、四肢的运动和声音的音调来传达不同的情感。

参与这项研究的35名自闭症儿童中,17名来自日本,18名来自塞尔维亚,年龄在3到13岁之间。在35分钟的实验过程中,他们以不同的方式对机器人做出反应,从有时看起来无聊和困倦,到兴奋地在房间里跳来跳去,拍手、大笑或触摸机器人。

研究中大部分的孩子对机器人”不仅仅是一个玩具,但有关NAO恭敬地如果是一个真正的人,“特别是在讲故事,在治疗师询问NAO会觉得如果孩子们把一个冰激凌的机器人,根据Rudovic。

一名4岁的小女孩躲在妈妈身后参与治疗,但她对机器人更加开放,在治疗结束时笑了起来。其中一个塞尔维亚孩子的姐姐给了NAO一个拥抱,说:“机器人,我爱你!她说,她很高兴看到哥哥这么喜欢和机器人玩。

“治疗师说,让孩子参与几秒钟的治疗对他们来说都是一个巨大的挑战,机器人会吸引孩子的注意力,”鲁多维奇说,他解释了为什么机器人在这类治疗中很有用。“此外,人类会用很多不同的方式改变他们的表情,但机器人总是用同样的方式来做,这对孩子来说不会那么沮丧,因为孩子会以一种非常有组织的方式学习表情将如何显示。”

信贷:安吉丽娜Lazarevic

个性化的机器学习

麻省理工学院的研究小组意识到一种被称为深度学习的机器学习将有助于机器人进行自闭症治疗,更自然地感知孩子的行为。深度学习系统使用分层的、多层的数据处理来改进它的任务,每一层都相当于对原始原始数据的稍微抽象的表示。

鲁多维奇说,尽管深度学习的概念早在20世纪80年代就出现了,但直到最近才有足够的计算能力来实现这种人工智能。深度学习已被用于自动语音和物体识别程序,使其非常适合于理解面部、身体和声音的多个特征,从而理解更抽象的概念,如儿童的参与度。

“例如,在面部表情的情况下,面部的哪个部分对评估参与度最重要?”Rudovic说。“深度学习让机器人可以直接从数据中提取最重要的信息,而不需要人类手工打造这些特征。”

通过将机器人用于自闭症治疗,Rudovic和他的同事将深度学习的想法进一步推进了一步,并建立了一个个性化的框架,可以从收集到的每个孩子的数据中学习。研究人员从孩子手腕上的监视器上捕捉到每个孩子的面部表情、头部和身体动作、姿势和手势、音频记录和心率、体温和皮肤出汗反应的数据。

这些机器人的个性化深度学习网络是由这些视频、音频和生理数据、关于儿童自闭症诊断和能力的信息、他们的文化和性别层层构建的。然后,研究人员将他们对孩子行为的估计与五位人类专家的估计进行了比较,这些专家对孩子的视频和音频记录进行了连续的编码,以确定孩子在会议期间表现出的高兴或沮丧、兴趣和参与程度。

在这些由人类编码的个性化数据上进行训练,并在没有用于训练或调整模型的数据上进行测试,对于研究中的大多数孩子来说,这些网络显著提高了机器人对孩子行为的自动估计,研究人员发现,如果该网络以一种“一刀切”的方法将所有孩子的数据合并起来,估计的数据就会更大。

鲁多维奇和同事们还探究了深度学习网络是如何做出估计的,发现了孩子们之间一些有趣的文化差异。Rudovic说:“例如,日本儿童在高度参与的情况下表现出更多的身体动作,而塞尔维亚儿童的大规模身体动作与脱离行为有关。”

这篇文章被转载麻省理工学院的新闻.

了下:机器人的报告,机器人技术•机器人抓手•末端执行器

告诉我们你的想法!