机器人Lightsabers决斗灯与黑暗的一面@Universal_Robot#sxsw.展示层。《星球大战》里有拿着光剑的机器人吗?严重的不算pic.twitter.com/lIihUJ5gpR

- DigitalLA (@DigitalLA)2018年3月13日,

正如马克哈米尔悲惨共享“星球大战:最后的绝地”的背后幕后,展出了一个包装的SXSW观众,下面的两个楼层楼层楼层普遍机器人重新创建了一般严重的“着名的轻型剑兵战斗。战斗机远离十二英尺跳舞库卡机器人和自动咖啡药物。不知何故,着名的互动节为期夜间饮酒,跳舞和音乐会今年的机械感受很大。随着乌托邦科的愿景和令人缺陷的人文主义,各地的辩论。

即使是我的小组)投资自治经济“在讨论为日益老龄化的人口使用机器人的机会时,出现了一个非常社会化的转变。曾在奥巴马政府任职的埃里克•戴姆勒(Eric Daimler)对人工智能偏见影响老年人福祉提出了担忧。Dan Burstein (Millennium Tech Value Partners的合伙人)对此表示赞同,他紧张地表示:“人工智能无处不在,无处不在,除了机器,美国没有其他方式来照顾这一爆炸性增长的人口。”戴姆勒解释说,“人工智能非常擅长感知,但不擅长环境;”如果这个问题得不到解决,它可能会成为全球范围内的一个非常危险的问题。

去年,在谷歌关于人类与人工智能关系的会议上,该公司负责工程的高级副总裁约翰·詹安德里亚(John Giannandrea)警告说:“真正的安全问题,如果你想这么称呼它,就是如果我们给这些系统提供有偏见的数据,它们就会有偏见。”重要的是,我们要对我们正在使用的培训数据保持透明,并寻找其中隐藏的偏见,否则我们就是在建立有偏见的系统。”与戴姆勒对人工智能和医疗保健的担忧类似,Giannandrea表示:“如果有人试图卖给你一个用于医疗决策支持的黑匣子系统,而你不知道它是如何工作的,或者是用什么数据来训练它,那么我不会相信它。”

关于人类偏见如何迅速影响电脑行为的最著名例证之一是微软(Microsoft)在Twitter上的客户服务聊天机器人Tay。Tay只花了24小时就变成了一个纳粹人物,引发了9万多条充满仇恨的推文。Tay很快计算出,社交媒体上的仇恨等于人气。在解释其失败的实验时商业内幕微软在电子邮件中表示:“人工智能聊天机器人Tay是一个机器学习项目,专为人类参与而设计。当它了解到,它的一些反应是不合适的,并表明了一些人与它的互动类型。我们正在对Tay做一些调整。”

相关:10家精通技术的公司正在寻找人工智能/机器人人才和知识产权

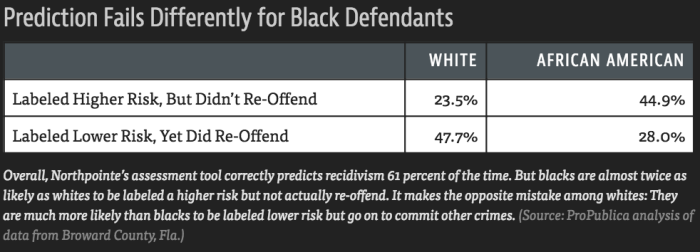

虽然Tay的真正影响是良性的,但它提出了将人工智能嵌入机器和社会的严重问题。在其获得普利策奖的文章, ProPublica.org发现,一款被广泛使用的美国刑事司法软件,名为“惩教罪犯管理另类制裁分析”(COMPAS),在对已定罪重罪犯重新犯罪的风险水平进行评分时,存在种族偏见。ProPublica发现,佛罗里达州的黑人被告“比白人被告更有可能被人工智能误判为更高的累犯率”。创建COMPAS的Northpointe公司也发布了自己的产品报告这是争议的Propublica的调查结果,但它拒绝将窗帘拉回其训练数据,使算法保持隐藏在“黑匣子”中。在发布的声明中纽约时报,Northpointe的发言人认为,“我们产品的关键是算法,他们是专有的。我们创建了它们,我们不会释放它们,因为它肯定是我们业务的核心作品。“

Northpointe和Propublica之间的争议提出了一个独立仲裁员来保护数据的透明度问题,以防止偏见。D.E的前Barnard教授和分析师Cathy O'Neil。Shaw,思考很多关于保护普通美国人的偏见AI。在她的书中,数学毁灭武器她注意到大公司美国太愿意将车轮交给算法,而无需完全评估风险或实施任何监督监测。

“(算法)取代了人工流程,但它们不遵循相同的标准。人们过于信任他们,”奥尼尔说。奥尼尔深知现任联邦政府的风险和监管缺失,于是辞去了她在华尔街的高薪工作,创办了一家软件审计公司——奥尼尔风险咨询与算法审计公司。在采访中麻省理工学院技术评论去年夏天,奥尼尔令人沮丧地表示,公司更感兴趣的是底线,而不是保护他们的员工、客户和家庭不受偏见。我现在没有客户。”

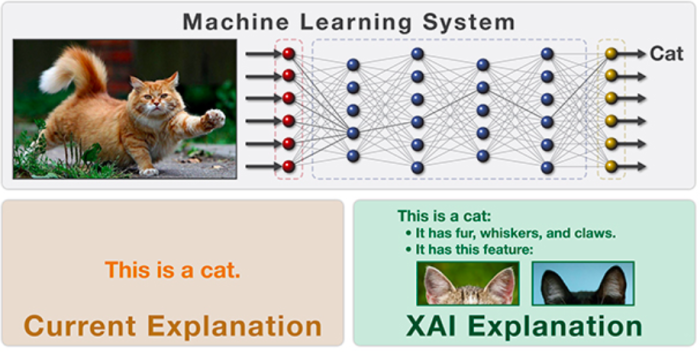

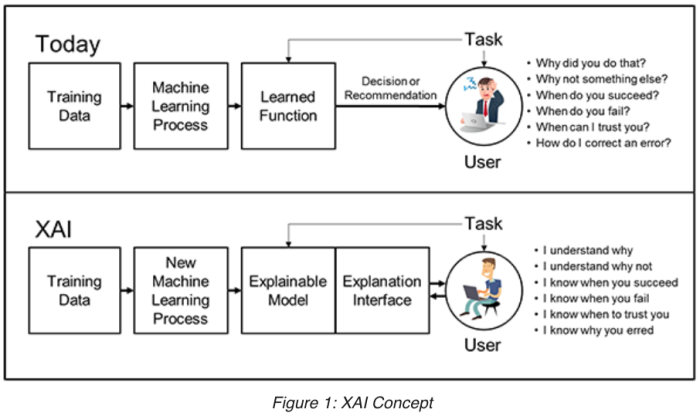

解构“黑匣子”的大部分成功案例都发生在今天的美国国防部。美国国防部高级研究计划局(DARPA)一直在资助大卫·康宁(David Gunning)博士开发可解释人工智能(XAI)的研究。对于美国的网络军事部门来说,了解本国和外国政府的人工智能可能是一个巨大的优势。与此同时,像许多美国国防部高级研究计划局资助的项目一样,民用机会也可以带来社会效益。根据Gunning的声明,XAI的目标是“生成更多可解释的模型,同时保持高水平的学习性能(预测准确性);并使人类用户能够理解、适当信任并有效管理新一代人工智能伙伴。”XAI计划与开发人员和用户界面设计师合作,培养“对最终用户有用的解释对话”,以知道何时信任或质疑人工智能生成的数据。

除了DARPA外,许多大型技术公司和大学开始创造智库,会议和政策小组,以制定测试AI偏见的标准。结果一直在令人震惊的 - 从计算机视觉传感器的范围内,对就业管理软件中的性别偏见,对自然语言处理系统的公然种族主义来说,对自然语言处理系统的公然种族主义,以证明威胁被错误地确定的安全机器人。作为培训数据如何影响结果的示例,当谷歌首次发布其图像处理软件时,AI将非裔美国人的照片确定为“大猩猩”,因为工程师未能向神经网络提供足够的少数群体。

最终AI反映了计划它的人,因为每个人都带来他自己的经历,塑造了个人偏见的经历。根据Kathleen Walch,AI今天播客,“如果研究人员和开发人员开发我们的AI系统本身缺乏多样性,那么AI系统解决和培训数据所使用的问题都基于这些数据科学家饲养给AI培训的偏见数据。“

沃尔奇主张,招聘多元化可以带来“不同的思维方式、不同的道德标准和不同的心态”。这将创造出更加多样化且更少偏见的AI系统。这将产生更有代表性的数据模型,AI解决方案将解决多样化和不同的问题,如果有更多样化的群体提供信息,这些系统将使用不同的用例。”

在离开SXSW之前,我参加了IEEE主办的关于“算法、无意识偏见和人工智能令人惊讶的是,所有小组成员都是女性,包括一名有色人种。雇佣基础成为他们讨论的一个大主题。演讲结束后,我坐上我的优步,愉快地前往机场,回想着Waymo首席执行官约翰•克拉弗西克(John Krafcik)当天早些时候发表的声明。Krafcik夸口说,Waymo的使命是打造“世界上最有经验的司机”。我只希望培训数据不是来自纽约的出租车司机。

提交:机器人报告

告诉我们你的想法!