麻省理工学院(MIT)的研究人员开发出了一种“心理变态”人工智能(AI),他们使用在线论坛Reddit上的图片为技术提供数据。这部电影以阿尔弗雷德·希区柯克的标志性反派诺曼·贝茨命名测试输入算法的数据如何影响其前景(又名其偏见倾向)。在这种情况下,Norman被暴露于Web的一些“最黑暗的元件”,这涉及对软件从Reddit子组以令人毛骨悚然的方式中死亡的人的图像,以确定这些照片如何影响软件。

诺曼是一个可以“看”和“了解”图像的特定AI计划,以及描述它以书面形式所看到的内容。在诺曼培训到这些图形图像之后,该软件执行了RORSCHACH测试 - 一系列墨迹心理学家用于分析患者的心理健康和情绪状态。然后将Norman对墨迹的解释与来自培训的AI软件的第二个品牌的响应进行了比较,这些乐趣是鸟类,猫和普通人的更多家庭友好的形象。

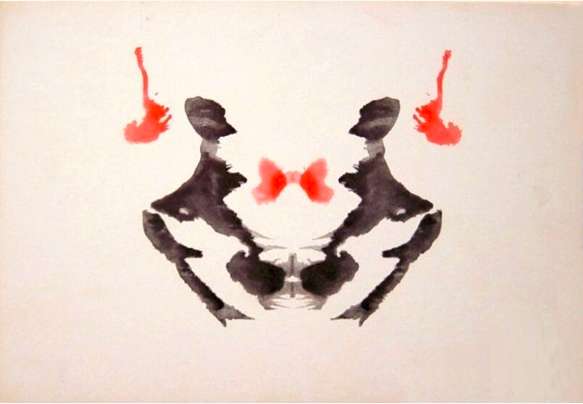

一个标准的ai认为这个红色和黑色墨迹代表了“几个人站在彼此相邻。”诺曼认为这是“男人从地板窗口跳”。(图片信用:麻省理工学院)

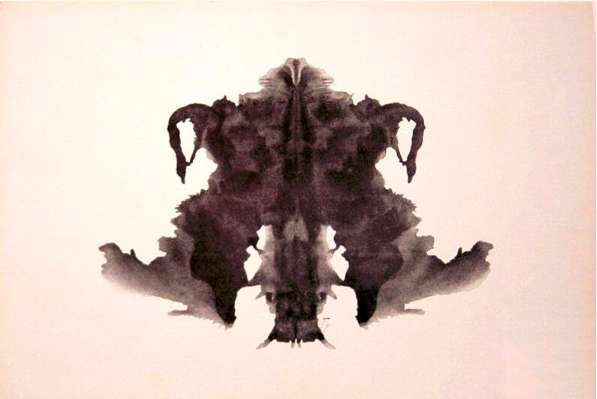

标准AI将墨迹解释为“棒球手套的黑白照片”,而诺曼将其描述为“人在白天的机枪谋杀”(图片信用:麻省理工学院)

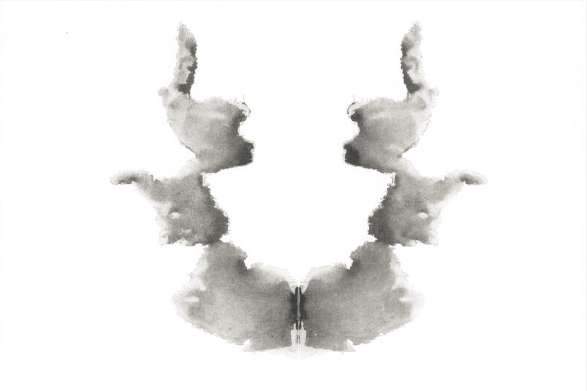

一个人认为这是“一只小鸟的黑白照片”。诺曼看到“男人被拉入面团机。”(图片信用:麻省理工学院)

这些发现最终表明,数据比算法更重要。诺曼因为长时间接触红迪网(Reddit)上这些黑暗、令人不安的图片而受到了严重影响。麻省理工学院的研究人员表示,这些发现有助于代表一个案例研究,即当有偏差的数据应用于机器学习算法时,人工智能出错的危险影响。

研究人员接着提到,这一趋势不仅在表现出心理变态倾向的人工智能上很明显,在其他被怀疑表现出偏见和偏见的算法上也很明显。例如,研究表明(无论是有意还是无意)人工智能可以捕捉到人类种族主义和性别歧视等不良特征。支持这一说法的一个例子是微软的聊天框Tay,它在开始说仇恨的短语和术语后不得不被关闭。

提交:AI•机器学习那M2M(机器到机器)